Laocaitv.vn - Theo các chuyên gia bảo mật, lừa đảo sử dụng công nghệ Deepfake rất nguy hiểm, tuy nhiên có những cách để người dùng nhận biết video sử dụng công nghệ ứng dụng trí tuệ nhân tạo này, từ đó tránh bị các đối tượng xấu lừa.

Laocaitv.vn - Theo các chuyên gia bảo mật, lừa đảo sử dụng công nghệ Deepfake rất nguy hiểm, tuy nhiên có những cách để người dùng nhận biết video sử dụng công nghệ ứng dụng trí tuệ nhân tạo này, từ đó tránh bị các đối tượng xấu lừa.

Theo các chuyên gia, clip tạo ra từ công nghệ Deepfake thường có dung lượng nhỏ, thời gian ngắn, chất lượng âm thanh, hình ảnh không cao; khuôn mặt khá cứng và ít cảm xúc.

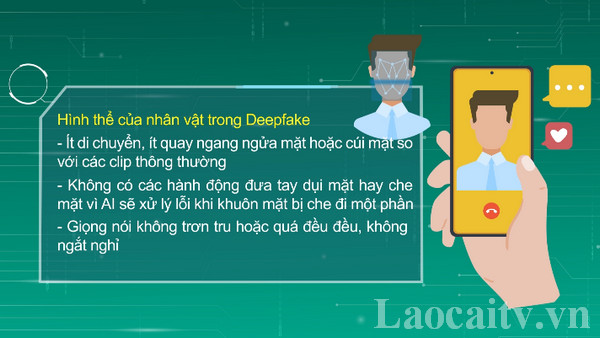

Hình thể của nhân vật trong Deepfake ít di chuyển, ít quay ngang ngửa mặt hoặc cúi mặt so với các clip thông thường, không có các hành động đưa tay dụi mặt hay che mặt vì AI sẽ xử lý lỗi khi khuôn mặt bị che đi một phần. Giọng nói không trơn tru hoặc quá đều đều, không ngắt nghỉ.

Người dùng cần kiểm tra lại bằng cách yêu cầu người gọi đưa tay lên mặt hoặc quay trái, quay phải; trao đổi càng nhiều càng tốt với người gọi; đặc biệt là không chuyển tiền, gửi thông tin vào các địa chỉ, tài khoản lạ.

Ngoài ra, người dân không nên để lộ quá nhiều thông tin riêng tư như số nhà, số căn cước công dân, hình ảnh, video có giọng nói trên mạng xã hội… Đây là kẽ hở để kẻ gian dễ dàng xây dựng những kịch bản lừa đảo ngày càng tinh vi hơn.

Đức Hoàng (biên soạn)

Bình luận

Tối thiểu 10 chữ Tiếng việt có dấu Không chứa liên kết